探索随机数据序列中的数据对称性:纯统计学视角

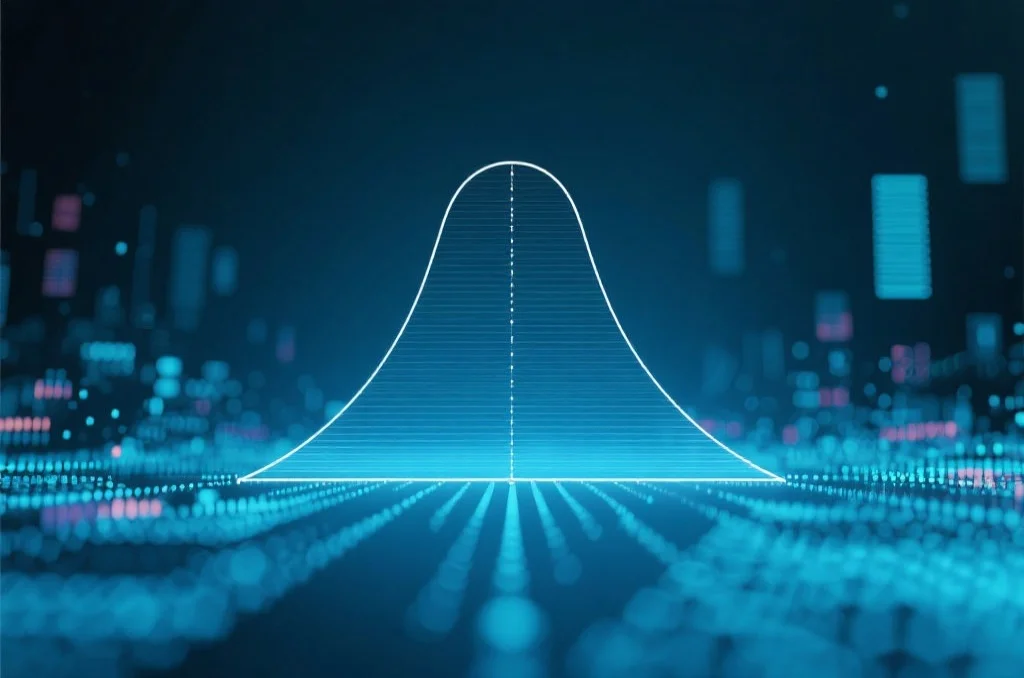

在数据科学和统计学领域,"数据对称性"是一个核心概念,它描述了数据分布的形状。当数据点均匀地分布在某个中心值两侧时,我们称其为对称的。例如,正态分布就是一个典型的对称分布,其均值、中位数和众数都位于分布的中心,且左右两侧的形状呈镜像关系。

理解数据对称性对于分析各种数据集至关重要,特别是那些由一系列独立随机事件组成的数值序列。在这些序列中,每个事件的结果被认为是独立的,且具有相同的发生概率。从理论上讲,如果事件足够多,这些结果的累积分布往往会趋向于某种对称形式,例如根据中心极限定理,大量独立同分布随机变量的和或平均值趋向于正态分布。

统计学方法与对称性检验

要量化和检验数据序列的对称性,统计学家通常会使用偏度(Skewness)和峰度(Kurtosis)等指标。偏度衡量了分布的不对称程度,如果偏度接近零,则表示分布近似对称。正偏度表示右侧尾部更长,负偏度表示左侧尾部更长。峰度则描述了分布的“尖锐”程度或尾部的“厚度”。

除了数值指标,可视化方法如直方图和核密度估计图也是判断对称性的有效工具。通过观察这些图表的形状,我们可以直观地评估数据是否围绕中心点对称分布。然而,对于有限的样本数据,即使是真正随机的序列,也可能因为随机波动而显示出一定程度的不对称性,这并非意味着数据本身存在固有的偏向性。

随机性与模式的错觉

在分析随机事件序列时,人类大脑倾向于识别模式,即使这些模式实际上并不存在。这种现象被称为“模式识别偏误”或“错觉关联”。例如,在一串随机生成的数字中,我们可能会“看到”连续出现的数字组合或某种看似有规律的序列,并误以为它们具有预测价值。然而,从统计学角度看,这些“模式”只是随机性固有的产物,其出现的概率符合随机分布的预期。

因此,对于任何声称在随机数据中发现“规律”或“对称性”的观察,都必须通过严格的统计检验来验证。只有当观测到的偏离随机预期的程度达到统计显著性时,我们才能谨慎地得出结论。在大多数情况下,对于真正随机生成的数据,其长期表现是无模式、无偏向的,任何短期内的“对称”或“不对称”都应被视为随机波动的一部分。

结论

数据对称性是理解数据分布特征的重要维度。在分析由独立随机事件构成的数值序列时,统计学工具和严谨的科学态度至关重要。我们应避免将随机波动误读为深层模式,并认识到在足够大的样本量下,真正的随机序列将展现出其固有的无偏性和宏观层面的统计规律,而非可预测的短期“对称”或“不对称”模式。